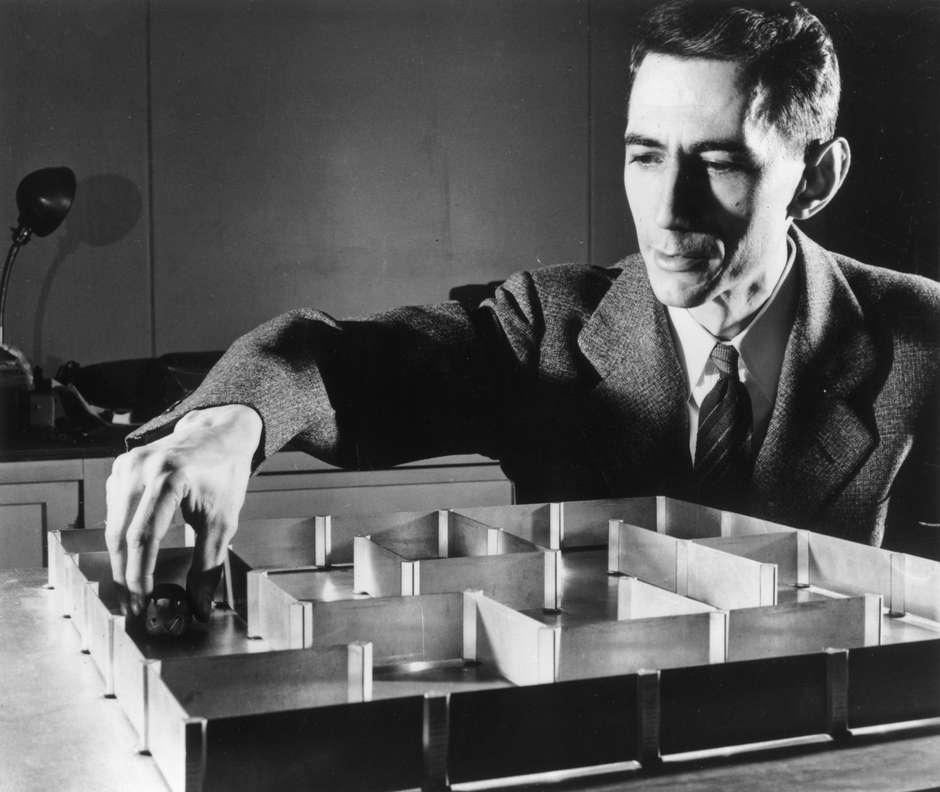

Claude Shannon, foi um dos pais da comunicação moderna

A palavra bit aparece pela primeira vez numa obra de Shannon

Shannon e seu famoso rato Teseu, com o qual fez experimentos em labirintos – alguns dos primeiros testes em inteligência artificial

(Foto: Getty Images)

Claude Shannon: pai da Teoria da Informação

Claude Shannon (nasceu em Petoskey, Michigan, em 30 de abril de 1916 – faleceu em Medford, Massachusetts, em 24 de fevereiro de 2001), matemático e informático norte-americano, cujas teorias sobre a linguagem binária aplicada ao circuito eléctrico tornaram possíveis as redes modernas de comunicação de massas.

Considerado o pai fundador da era de comunicação eletrônica, Claude Shannon foi um engenheiro matemático cujo trabalho em problemas técnicos da comunicação lançou as bases tanto para a indústria de computadores quanto para as telecomunicações. Enquanto trabalhava no laboratório criado por Graham Bell, em 1942, o americano formulou uma teoria explicando a comunicação das informações e contribuiu para o estudo do problema sobre como transmitir informação de maneira mais eficiente.

A teoria matemática da comunicação feita em conjunto com o matemático Warren Weaver foi o ponto alto das investigações científicas de Shannon. O conceito de entropia transposto para a comunicação também foi um importante aspecto da teoria – ele demonstrou que a entropia da informação era equivalente à falta de conteúdo informativo, um grau de incerteza em uma mensagem.

Claude Elwood Shannon nasceu em Petoskey, Michigan, em abril de 1916. Matemático e engenheiro eletrotécnico de formação, passa à posteridade sobretudo por duas obras teóricas de primeiro plano, que fizeram dele – a par do seu contemporâneo e mentor Norbert Wiener (1894-1964) – fundador da cibernética e um dos pais do conceito de “comunicação” moderna.

Estudou engenharia elétrica e matemática no Instituto de Tecnologia de Massachusetts, onde concluiu seu mestrado e doutorado em 1940. Apaixonado por música, tinha cinco pianos e 30 outros instrumentos em casa, de flautins a trompetes. Inventor nato, contava com uma máquina de jogar xadrez, um monociclo com uma roda descentralizada e outros inventos.

“A Symbolic Analysis of Relay and Switching Circuits” (1940), usou a álgebra de Boole para estabelecer a teoria de apoio para os circuitos digitais, considerados fundamentais nos sistemas operativos dos computadores modernos e equipamentos de telecomunicações. Por esta razão esta tese de Claude Shannon foi considerada uma das mais importantes do século XX.

Em 1948, Shannon publica “A Mathematical Theory of Communication”, onde é esquematizada uma teoria da informação de um modo tão completo que a sua terminologia e teses ainda hoje são usadas. A palavra bit, por exemplo, aparece pela primeira vez nesta obra.

A teoria da informação de Shannon teve um sucesso imediato junto dos engenheiros de comunicação e continua a ser útil a várias outras áreas como a biologia, linguística, psicologia, economia e física. Ao início houve tanto entusiasmo à volta das teses de Shannon que o próprio, em 1958, escreveu um artigo (“The Bandwagon”) onde tenta refrear as expectativas.

Shannon trabalhou para a Bell Telephone Laboratories como matemático pesquisador a partir de 1941. Ali, se dedicou a aprimorar a qualidade da transmissão de informações. Em 1948, conseguiu explicar o problema fundamental da comunicação de maneira quantitativa: a unidade básica de informação é uma situação de “sim-não”. Ou algo é ou não é. Isso pode ser expressado através da álgebra binária booleana por meio dos números 1 e 0, onde 1 significa “sim” (ou ligado) e 0 significa “não” (ou desligado). Esse é hoje o “sistema nervoso” de cada computador no mundo.

Claude Shannon faleceu em 24 de fevereiro de 2001, aos 84 anos, em Medford, Massachusetts, vítima da doença de Alzheimer.

(Fonte: http://www.publico.pt/sociedade/noticia – SOCIEDADE – NOTÍCIA – 28/02/2001)

(Fonte: http://tecnologia.terra.com.br – Claude Shannon: pai da Teoria da Informação – NOTÍCIAS – TECNOLOGIA – 30 ABR 2013)